Die Zusammenarbeit von Wissenschaft und neuen Technologien ist von großer Bedeutung, um innovative Lösungen zu entwickeln. Neue Technologien ermöglichen effizientere Datenerfassung und -analysen, erschließen neue Forschungsbereiche und beschleunigen den Fortschritt in verschiedenen Bereichen wie Medizin und Umweltschutz. Zoologische Gärten können dabei eine große Unterstützung bieten und bieten Möglichkeiten für Beobachtungen und Studien von Tieren in kontrollierten Umgebungen.

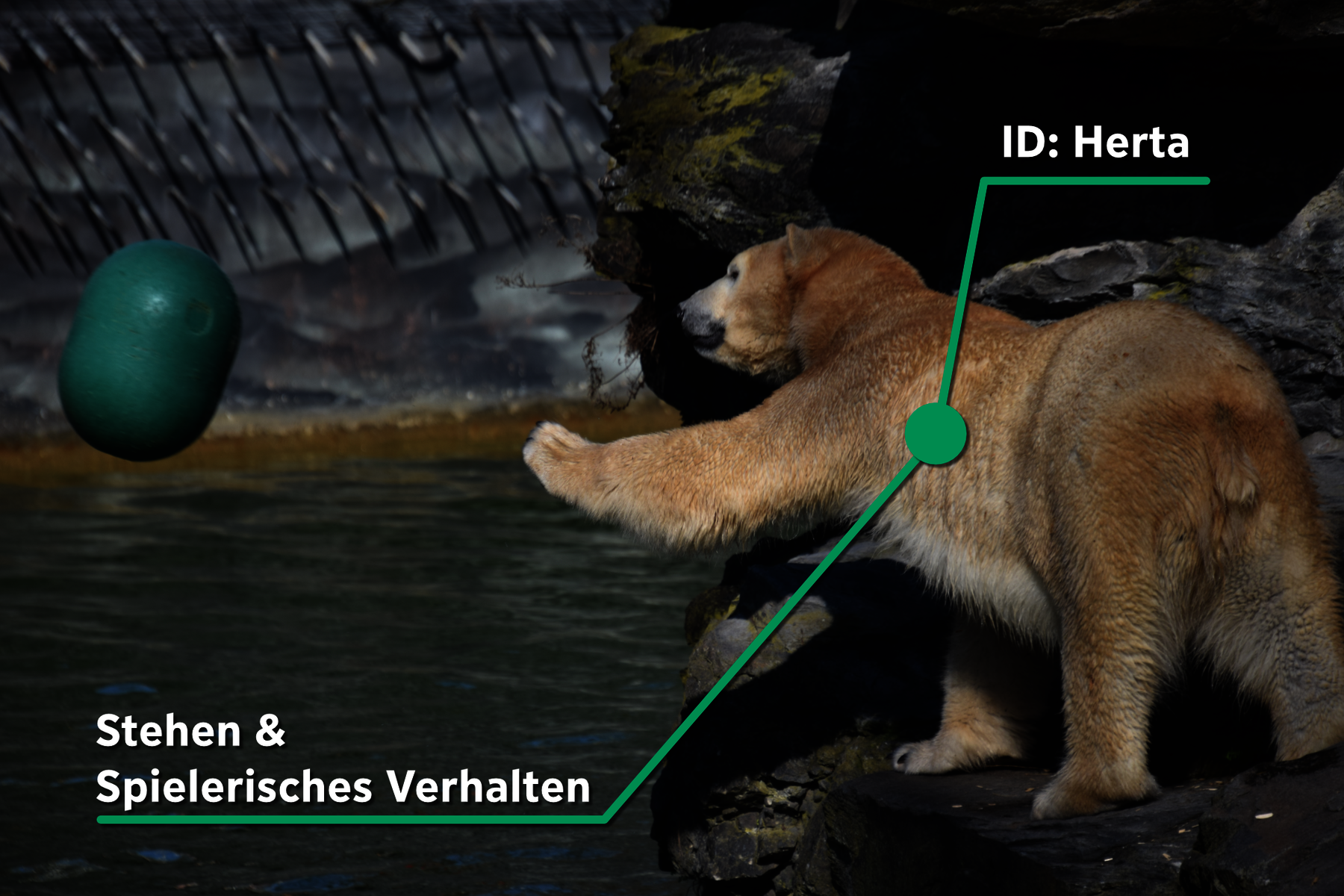

Ein Experte auf diesem Gebiet ist Matthias Zuerl. Er ist Researcher & PhD Candidate und am Department Artificial Intelligence in Biomedical Engineering (AIBE)“ der Friedrich-Alexander-Universität Erlangen-Nürnberg tätig. Sein Forschungsprojekt VERA (Video-based Re-Identification for Animals) ist ein automatisiertes videobasiertes Analysesystem für die Verhaltensüberwachung einzelner Tiere mithilfe von Deep Learning. Bei seiner Studie haben ihn die beiden Eisbären im Tierpark unterstützt.